概述

目标读者

本书《TensorStack AI 计算平台 - User Console 用户手册》 的目标读者是“TensorStack AI 计算平台”的使用者,包括:

- AI 研究人员

- 建模工程师

- 数据处理工程师

- 机器学习工程师

- AI 应用开发工程师等

系统管理员、运维人员需要参考另外的《TensorStack AI 计算平台 - 管理员手册》系列。

产品概述

TensorStack AI 计算平台是面向 AI 集群的系统软件,针对 AI 集群的硬件架构和 AI 领域的计算任务的特性和需求,提供稳定、可扩展的 AI 技术平台能力,服务 AI 技术研发、应用和规模化落地。

AI 集群的拥有者可以使用这套软件,构建自己的 AI 私有云或 AI 混合云基础设施服务。

产品提供了全面的可扩展性:用户可方便的安装各种 Apps 以满足具体应用场景的需求;管理员可以在线安装各种 APIs 以支持系统服务能力扩展;集群规模上,支持在 1~10^3 节点部署。

通过先进的架构和丰富的 APIs + Apps,TensorStack AI 计算平台合理地隐藏了分布式并行、异构计算、加速计算等技术的复杂细节,提高了抽象层次,并为 AI 领域的各种计算提供了针对性的支持,极大地提升了 AI 技术研究、开发、应用的工作效率。

User Console

“User Console(用户控制台)” 是 TensorStack AI 计算平台的用户交互界面,它为 AI 集群使用者提供了一个集中使用集群功能的图形化环境。

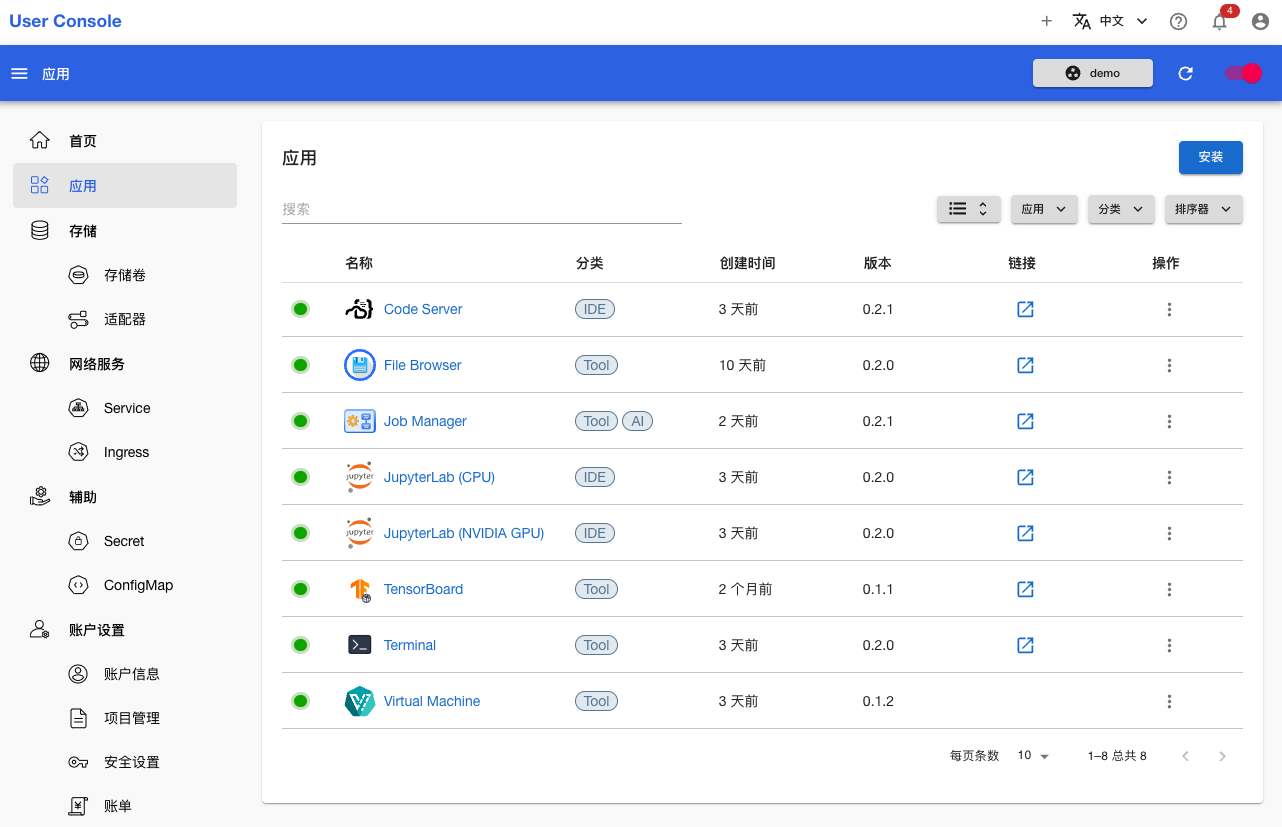

Apps

用户可在 User Console 中方便的安装和使用各种 Apps(应用),是用户使用平台功能的入口。无论是进行 AI 研究、开发还是部署,用户都是通过安装和使用相应的 App 来完成。例如:

- AI 研究员可能通过 JupyterLab App 作为其日常开发环境,使用 Job Manager App 运行和管理并行训练任务。

- AI 应用工程师可能使用 vLLM App 或 Stable Diffusion WebUI App 来部署和测试 AI 模型。

APIs

APIs 提供集群系统服务,用户可以通过 User Console 直接或间接使用。它们或为 Apps 提供必要的支持:

- 存储如持久卷(PV + PVC) 和适配器(StorageShim)为 Apps 持久化保存数据,存储模型、数据集和训练日志文件等。

- 网络服务如 Service 和 Ingress 为 Apps 提供内部通信和外部访问的能力,使得 Apps 能够相互协作并对外提供服务。

- 辅助资源如 Secret 和 ConfigMap 为 Apps 提供配置管理和敏感信息保护,确保 Apps 能够安全且灵活地运行。

或作为工作负载执行某项特定计算:

- Job 如 PyTorchTrainingJob 和 DeepSpeedJob 运行以 AI 模型训练为主的批处理计算任务。

- 推理服务如 MLService 和 SimpleMLService 部署 AI 模型为推理服务。

- 工作流 APIs 将多个平台操作步骤组合为一个工作流,进行集中管理和运行

- AutoTuneExperiment 进行 AI 模型训练的自动超参数调优。

除此之外,User Console 还提供了账户设置功能,帮助用户管理账户的项目和 API Key,接受账单和来自平台的告警信息。